Las 5 claves para entender el universo bot

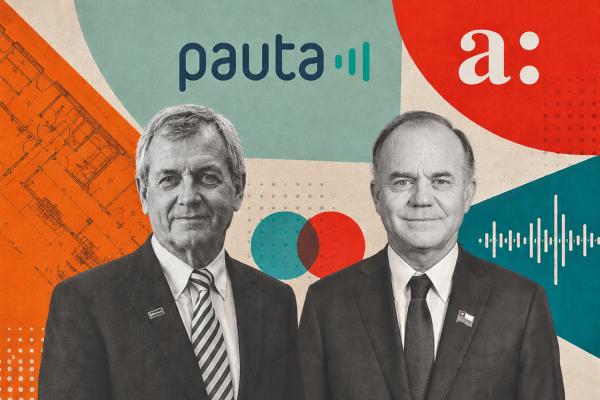

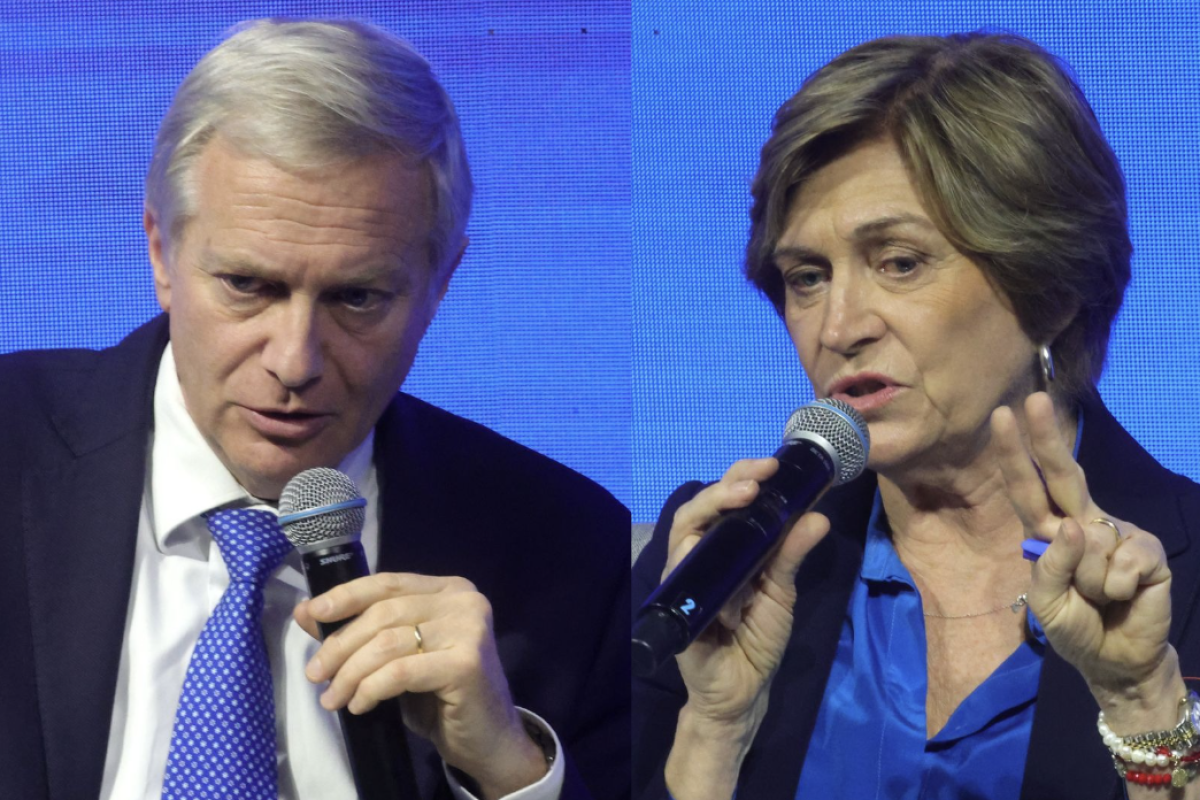

El lunes de esta semana, Evelyn Matthei anunció que interpondría una querella en contra del partido de su contrincante, José Antonio Kast, por su eventual responsabilidad en la propagación -de manera coordinada- de información falsa y/o modificada sobre ella en redes sociales. Específicamente, a través de bots. Pese a que la candidata desistió el miércoles de su decisión, no es la primera vez que este sistema de software marca la pauta y siembra dudas en cuanto a su funcionamiento. Aquí, Marcelo Santos, académico y experto en el tema, explica cómo funciona este mercado.

Por: Catalina Vicuña

Publicado: Sábado 2 de agosto de 2025 a las 21:00 hrs.

Noticias destacadas

1. ¿Qué son?

Bot es la abreviación de robot: es una pieza de software que se puede programar con un comportamiento rutinario que dispara cierta actividad. “Funciona con la lógica del ‘sí x, entonces y’; en inglés, con ‘if, then’”, explica Marcelo Santos, publicista, doctor en Ciencias de la Comunicación y académico de la Universidad Diego Portales, quien desde hace más de 15 años estudia los cruces entre tecnología y democracia. “Alguien podría programar una cuenta de X (ex Twitter) con la instrucción de: ‘Si Kast publica algo, entonces le pones me gusta’, ‘si Boric publica algo, entonces le tiras un garabato’”, ejemplifica.

El objetivo de estas cuentas es instalar temas tendencia en redes sociales y, por tanto, en la opinión pública. Para generar este impacto, explica el académico, generalmente se trabaja con redes de bots. “Estas no son personas reales o humanas, pero tienen una actividad coordinada y actúan juntos con un propósito específico que alguien programa previamente”, señala.

2. ¿Quiénes los manejan?

El experto afirma que, generalmente, quienes están detrás de estos servicios de programación se denominan “agencias de comunicaciones”. “Éstas podrían instalarse acá en esta casa”, sostiene. “Ponemos un par de mesas, varios celulares enchufados -con un montón de usuarios de X creados artificialmente- y a alguien que sepa mucho de informática para que maneje un programa y gestione el disparo de mensajes coordinados entre los dispositivos”, dice. “Imagínate. Varios celulares aquí y cada dos minutos un bot dispara algo, después el otro, el otro, y así hasta ser tendencia en redes sociales. Yo he hecho ese ejercicio de coordinación -de manera manual- en clases con mis alumnos”.

Estas “agencias” están en Internet y son fáciles de encontrar, porque lo que hacen no es ilegal, dice Santos: “Si fuera regulado, y se prohibiera el uso de bots en campañas políticas, bueno, ahí se les podría sancionar y serían un poquito más discretas”.

Las cuentas se crean, alimentan, consolidan y luego comercializan. Mientras más antiguas -usuarios con historia, fotos, etc.- su valor es más caro.

Santos cuenta una anécdota: “Cuando ocurrió el caso de Johnny Depp y Amber Heard, también hubo una campaña de bots, un comportamiento inauténtico coordinado. Un día, un periodista de Inglaterra me llamó y me preguntó por una cuenta de X de nombre Felipe Irarrázabal, que tenía publicaciones de pro Rechazo, luego pro Kast, pero que luego se mantuvo en silencio por un tiempo... Hasta que empezó a publicar en inglés en pro de Johnny Depp. En ese caso, es muy evidente que era una cuenta bot que estaba inactiva porque no había clientes”.

3. ¿Se puede saber quién es?

La única forma de saber si un usuario es un bot, es a partir de la dirección IP de la cuenta, es decir, del lugar -que puede ser una comuna o una región- desde donde ésta emite los mensajes. Esa dirección IP, asegura Santos, sólo la tiene X y llegar a dichos datos no es sencillo. En 2021, luego de realizar una investigación sobre la presencia de bots y la carrera presidencial, junto a los académicos Maria Luiza Mondelli y Jorge Valdebenito, tomó contacto con la red social para comparar su base de datos con sus direcciones IP. “Me reuní dos veces con ellos por Zoom y su respuesta fue: ‘muchas gracias, vamos a ver lo que hacemos pero no te podemos prometer nada’”. Cumplieron. “Nunca hicieron nada”, asegura Santos.

Sin esa colaboración directa, “sólo se podría saber si un grupo de usuarios efectivamente son bots con un whistleblower”, asegura Santos. En el caso de Evelyn Matthei, añade, “cuando su comando dice: ‘Sabemos que hay bots’, la única posibilidad que se me ocurre de que tengan esa certeza es que alguien les haya filtrado esa información. Yo como académico puedo decirte que un usuario tiene 90% de posibilidades de ser un bot, pero no puedo decirte con completa certeza de dónde viene, si de Providencia, Macul, Costa Rica, o Bangladesh”.

A ese 90% de probabilidades se llega así: primero, cuando se trata de cuentas que no publican nada, sólo hacen retweets y dan me gusta. “Incluso hay veces donde el número de likes y retweets son iguales: eso pasa porque el usuario está programado con: ‘toda vez que se mencione al político X, pon me gusta y haz retweet’”, explica el experto.

Otro “check” es su fecha de creación: muchas de las cuentas nacieron el 4 de julio de 2020, el día en que se inició el proceso constituyente. Otro factor que hace dudar son ciertos patrones lingüísticos: tweets que tienen igual cantidad de palabras. “En una tabla de Excel se ve el patrón, hay una permutación entre palabras clave y adjetivos. Además, agregan varios hashtags de tendencia”, asegura Santos.

4. ¿Podemos apuntar con el dedo?

En 2021, Marcelo Santos puso la lupa en las cuentas de X que participaron de conversaciones sobre la carrera presidencial. Con un software -que desarrolló el Instituto de Tecnología y Sociedad de Río de Janeiro-, descubrieron a cerca de 20.000 usuarios con alta probabilidad de ser bots.

Para diciembre de ese año, junto a los académicos Sebastián Valenzuela y Marcelo Mendoza, Santos publicó otra investigación –disponible online– que constató que “un 30% de los bots que siguen a Boric son opuestos ideológicamente a él, mientras que solo el 4% de los que siguen a Kast lo son. Es decir, hay 7,5 veces más bots que podrían atacar a Boric que a Kast”.

En dicho proceso de investigación, también se analizó el tipo de mensaje que hacían los 50 bots que más publicaron. “Ahí claramente los de Kast eran todos positivos y los de Boric, Provoste y Sichel eran casi todos negativos. Estos últimos tres no tenían campaña de bots en contra”, asegura el académico.

“Esos resultados demuestran que había una actividad vinculada a los intereses de Kast y eso lo puedo afirmar. No puedo afirmar que era su comando o su jefe de campaña el que estaba detrás, tampoco tengo evidencia de una factura pagada a una agencia de bots. Pero sí puedo decir que es una práctica que no es novedosa. Evelyn alega, Káiser alega. Y hoy tú ves que los usuarios que lo hacen son apoyadores de Kast. El patrón es igual al 2021”, explica el experto.

5. ¿Quiénes ganan?

La pregunta está sobre la mesa. ¿Quiénes ganan con la presencia de fake news, videos alterados y bots en X? A primera vista, en política, se podría pensar que son los contrincantes de los afectados. Sin embargo, existe un personaje clave: el mismo X. “Mientras no se alce la voz en el tema, esto es un negocio”, asegura Santos.

“Por algo no hacen nada o hacen muy poco. Hacer algo les cuesta y además pierden. ¿Y qué pasa? Con la información que circula sobre los candidatos, uno se mete a X a ver qué está pasando, a buscar las fotos, los videos, etc. Pero, en eso, quizás cuánto tiempo uno pasa ahí, cuánta publicidad uno se come, cuántas marcas ganan”, añade.

Replicar la investigación que el académico realizó en 2021 es complicado, asegura. Para ese entonces, el grupo de académicos utilizó una base de datos que el mismo Twitter le proveyó con un programa especial para investigadores. “Elon Musk cerró esa opción y hoy para acceder a datos hay que pagar un precio muy caro. Pasó a ser privilegio de pocos”, dice Santos. Lo mismo con las reuniones de Zoom que mantuvo con trabajadores de la plataforma años atrás. “Cuando Twitter se transformó en X, se desarmó toda la mediación y el policy making, toda la estructura de una empresa que entendía que a pesar de ser privada tenía un rol público”.

Te recomendamos

ARTICULOS RELACIONADOS

LO MÁS LEÍDO

Newsletters

Agrosuper y Hubtec lanzan cuarta versión de convocatoria de I+D para abordar desafíos de la industria alimentaria

La iniciativa está dirigida a universidades, institutos, centros de investigación y startups, con foco en soluciones para mejorar la seguridad y vida útil de los alimentos, economía circular, procesos productivos y sostenibilidad.

Vecinos de Villa Panamericana de Cerrillos demandan a desarrolladores del proyecto por casi US$ 18 millones

Acusan serias deficiencias en la calidad de los departamentos entregados en 2024. La inmobiliaria a cargo respondió que “desde que entregamos las primeras viviendas del lote B, hemos atendido los requerimientos e inquietudes de los vecinos, y lo seguiremos haciendo a través de nuestro servicio de postventa”.

BRANDED CONTENT

Un salto hacia la electromovilidad:

La iniciativa, que estará vigente hasta el 31 de mayo de 2026 o hasta agotar las 500 unidades, busca facilitar el acceso a los vehículos eléctricos, en un contexto marcado por la búsqueda de alternativas más sustentables y eficientes ante el alza de los combustibles

Un salto hacia la electromovilidad:

La iniciativa, que estará vigente hasta el 31 de mayo de 2026 o hasta agotar las 500 unidades, busca facilitar el acceso a los vehículos eléctricos, en un contexto marcado por la búsqueda de alternativas más sustentables y eficientes ante el alza de los combustibles

Dra Susan Bueno y el impulso que la mueve a avanzar, investigar y aportar a la sociedad.

Su curiosidad temprana la llevó a estudiar las enfermedades infecciosas y a contribuir en el desarrollo de la primera vacuna aplicada masivamente en Chile contra el Covid-19. Hoy, la Dra. Susan Bueno, reconocida en 2024 como inventora del año, continúa aportando desde la investigación al fortalecimiento de la salud. Mira aquí su entrevista

En Perfeccionistas entrevistamos a un deportista chileno que quiere llegar tan alto como sus saltos

Mauricio Molina nos cuenta de su pasión por el BMX y cómo se convirtió en el primer chileno en competir en esta disciplina en unos Juegos Olímpicos y ser parte del selecto grupo de los 25 mejores del mundo.

Instagram

Instagram Facebook

Facebook LinkedIn

LinkedIn YouTube

YouTube TikTok

TikTok